개요

주요 Public Cloud 벤더(AWS/GCP/Azure)는 API를 통해 파운데이션 모델(Foundation Model)을 사용하고 배포 할수 있는 AI/ML 모델 서비스를 제공하고 있습니다.

이와 같은 고성능 AI 모델을 별도의 서버 구축이나 운영 부담 없이 API 호출을 통해 사용 가능하도록 제공하는 기능을 MaaS (Model as a Service)로 칭하기도 합니다.

최근 수행중인 프로젝트 내 해당 서비스 도입을 검토하면서 각 벤더사 별 AI/ML 서비스에 대한 비교 분석을 수행하였고, 각 서비스 별 호출 방법에 대해 정리하였습니다.

1. Public Cloud별 AI/ML 모델 서비스 심층 비교 및 특징

각 Publisher 별로 제공하는 AI/ML 모델 서비스는 서로 비슷하지만, 각기 다른 특징을 가지고 있습니다.

완전 관리형 인프라, 종량제, API 제공 등 공통되는 특징 뿐 아니라 서비스 별로 차별화되는 특징들이 존재합니다.

1.1. 서비스 공통 특징

완전 관리형(Fully Managed) 인프라 추상화: 별도의 GPU 인스턴스 구성 등 모델 호스팅을 위한 서버 프로비저닝 없이 관리형 엔드포인트를 통해 추론 및 파인튜닝 작업을 수행가능.

API-First 아키텍처 및 표준 SDK 지원: REST/gRPC API 및 각 언어별 공식 SDK를 제공하여, 개발자가 애플리케이션 코드 내에서 모델 호출, 파인튜닝 파이프라인 제어 등을 프로그래밍 방식으로 쉽게 통합 가능

종량제(Pay-as-you-go) 및 예약형 과금 모델: 기본적으로 처리된 토큰 수나 컴퓨팅 시간에 비례하여 과금되는 종량제 형태로 비용 과금

다양한 파운데이션 모델 및 파인튜닝 환경 제공: 검증된 최신 AI 모델(GPT, Gemini, Claude 등)을 제공하며, 필요시 파인 튜닝을 통한 특화 모델을 구성하여 사용 가능

1.2. AWS Bedrock

- 대표 모델

- Amazon Nova 2 (Pro/Lite/Omni)

- 주요 특징

- 교차 리전 로드밸런싱 : 트래픽 과부화 시 별도의 엔드포인트 혹은 LB 구성 없이 자동으로 유휴 리전으로 트래픽을 넘길 수 있음 ex) us-east-1 -> us-west-2

- Guardrails을 통한 보안 준수: 생성형 AI 모델의 입/출력 과정에서의 유해 콘텐츠, 민감 정보(PII) 등을 실시간으로 차단 및 마스킹하는 기능을 지원

- 단일 통합 호출 인터페이스 제공 : Anthropic, Meta, Amazon 등 제조사가 전혀 다른 모델 들을 동일한 API 스키마를 통해 호출 가능

- 사전 프로비저닝된 공용 모델 ID 제공 : 모델 배포나 인프라 구성 과정 없이, 제공되는 공용 모델 ID를 통해 즉시 API 호출이 가능. (Bedrock 내 모든 서드파티 및 자사 파운데이션 모델 적용)

- API 인증 방식

- IAM 기반 자격 증명: 별도의 API Key 발급 없이 AWS 표준 자격 증명(Access/Secret Key)을 사용

- 자동 권한 상속: EC2, EKS, Lambda 등 컴퓨팅 자원에 부여된 IAM Role을 자동으로 상속받아 안전한 호출 환경을 구성

1.3. GCP Vertex AI

- 대표 모델

- Gemini 3.1 Pro / Flash

- 주요 특징

- 운영 편의성을 위한 부가 기능 제공 : Model Registry를 통한 버전 관리, Colab Enterprise 등의 다양한 부가 기능을 제공

- 기존 데이터 플랫폼과의 통합: BigQuery와 연동을 통해 SQL 쿼리 내에서 직접 Gemini 모델을 호출하여 정형 데이터와 비정형 데이터를 동시에 분석 가능

- Cloud TPU 사용 가능: 모델 배포시 NVIDIA GPU외 TPU 인스턴스를 통해 모델 배포환경을 구성 가능

- 사전 프로비저닝된 공용 모델 ID 제공 : 모델 배포나 인프라 구성 과정 없이, 제공되는 공용 모델 ID를 통해 즉시 API 호출이 가능 (Google 1st-party 및 Model Garden 관리형 모델 적용)

- API 인증 방식

- ADC (Application Default Credentials): GCP 표준 인증 방식을 활용하여 일관된 개발 및 운영 환경 인증을 제공

- 서비스 계정 연동: GCE, GKE 등의 클라우드 환경에서는 별도의 키 관리 없이 연결된 서비스 계정(Service Account)의 권한을 통해 자동으로 인증 가능

1.4. Microsoft Foundry ( 구 Azure AI Studio / Azure AI Foundry)

- 대표 모델

- GPT-5

- 주요 특징

- PTU (Provisioned Throughput Unit): 모델 처리량을 사전에 예약하여 안정적인 성능과 예측 가능한 응답 특성을 확보하는 전용 용량 할당 방식을 사용

- 인프라 레벨 보안 프록시 : AI Content Safety 기능을 통해 API 요청이 모델에 도달하기 전, 별도의 딥러닝 필터망을 통해 악성 페이로드를 선제적으로 차단 가능

- 공용 모델 ID 미제공: 공용 모델 ID를 제공하지 않으므로, 호출 전 반드시 사용할 모델에 대한 엔드포인트 구성 작업이 필요

- API 인증 방식

- API Key & Endpoint: 전용 엔드포인트 URL과 API Key를 주입하는 방식 (기존 openai 패키지와의 코드 호환성)

- Entra ID (RBAC) 지원: API Key 대신 Entra ID를 활용한 역할 기반 토큰 인증 방식도 지원

2. Public Cloud 간 LLM 서비스 요약

| 비교 항목 | AWS Bedrock | GCP Vertex AI | Microsoft Foundry (구 Azure OpenAI) |

| 주력 모델 | Amazon Nova 2 | Gemini 3.1 Pro / Flash | GPT-5 |

| 멀티 모델 선택권 | 매우 높음 (단일 통합 API 스키마로 제조사가 다른 여러 모델 즉시 교체 가능) | 보통 (Gemini 및 자체 모델 중심, 통합 플랫폼 내 구동) | 낮음 (OpenAI 최신 SOTA 모델 독점 공급에 집중) |

| 주요 과금 정책 | 종량제(Pay-as-you-go), 예약형 | 종량제(Pay-as-you-go), 예약형 | 종량제(Pay-as-you-go), PTU (전용 용량 할당) |

| 핵심 차별화 특징 | – 교차 리전 로드밸런싱 – 단일 통합 호출 인터페이스 – Guardrails 실시간 보안 차단 | – Model Registry/Colab 등 운영 통합 – Cloud TPU 인프라 지원 | – 최신 GPT 독점 공급 – 인프라 레벨 보안 프록시 – Entra ID (RBAC) 네이티브 통합 |

| 공용 모델 ID 제공 | O | O (특정 모델 한정 제공) | X |

| 인증 방식 (Auth) | IAM 기반 (자동 권한 상속) | ADC 및 서비스 계정(SA) 연동 | API Key 또는 Entra ID |

3. 각 벤더별 모델 호출 API 구성 및 모델 호출 테스트

3.1. AWS Bedrock (Amazon Nova 호출)

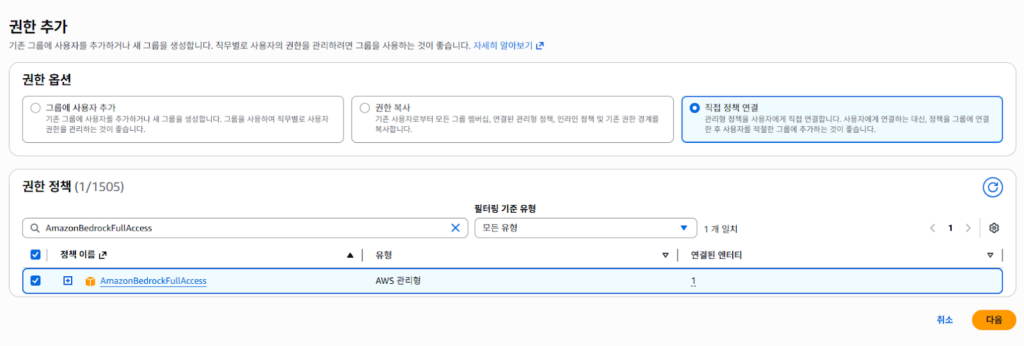

[사전 설정 (Prerequisites)].

- IAM 설정: 사용자의 IAM 권한에 AmazonBedrockFullAccess 권한 부여

- Region 내 사용 가능 모델 목록 확인 : AWS CLI를 통해 리전 내에서 사용가능한 모델 목록 및 inferenceProfileId 값을 확인

| $ aws bedrock list-inference-profiles –region ap-northeast-2 |

| “inferenceProfileName”: “GLOBAL Amazon Nova 2 Lite”, “description”: “Routes requests to Amazon Nova 2 Lite globally across all supported AWS Regions.”, “createdAt”: “2025-11-04T23:44:18.035422+00:00”, “updatedAt”: “2025-11-22T21:08:12.046889+00:00”, “inferenceProfileArn”: “arn:aws:bedrock:ap-northeast-2:108547894481:inference-profile/global.amazon.nova-2-lite-v1:0”, “models”: [ { “modelArn”: “arn:aws:bedrock:::foundation-model/amazon.nova-2-lite-v1:0” }, { “modelArn”: “arn:aws:bedrock:ap-northeast-2::foundation-model/amazon.nova-2-lite-v1:0” } ], “inferenceProfileId”: “global.amazon.nova-2-lite-v1:0“, “status”: “ACTIVE”, “type”: “SYSTEM_DEFINED” }, |

- AWS 인증정보 파일 설정 : 호출에 사용할 AWS 계정인증정보가 담긴 파일을 생성

| AWS_ACCESS_KEY_ID=xxxxx AWS_SECRET_ACCESS_KEY=xxxxxxxxx AWS_DEFAULT_REGION=ap-northeast-2 |

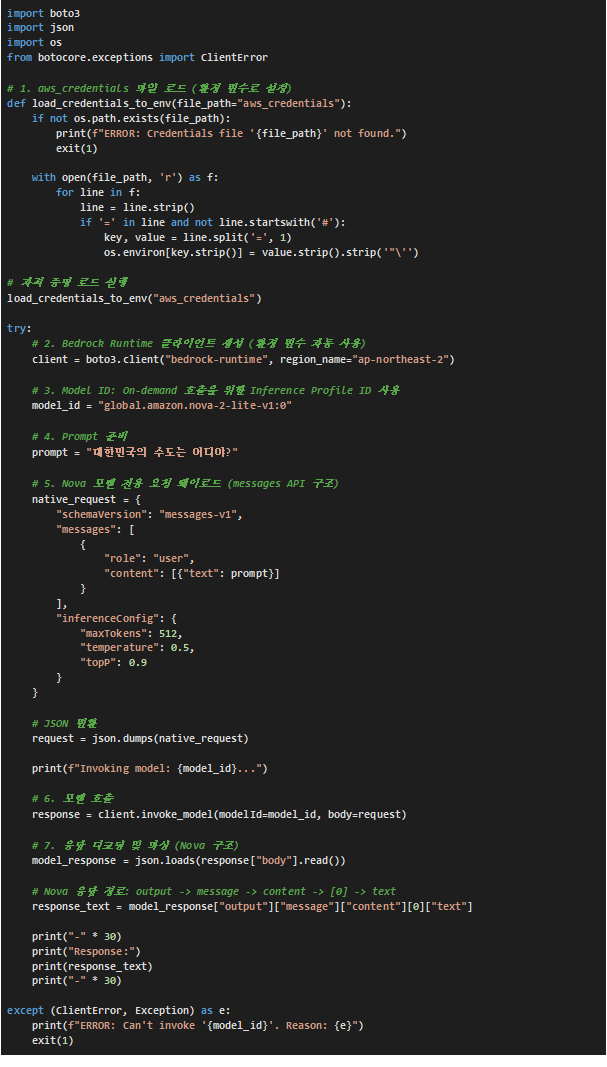

- 호출 작업 환경 구성 : boto3 pip 패키지 설치 및 스크립트 구성

# AWS Bedrock을 통한 AWS Nova Lite 2 모델 호출 스크립트

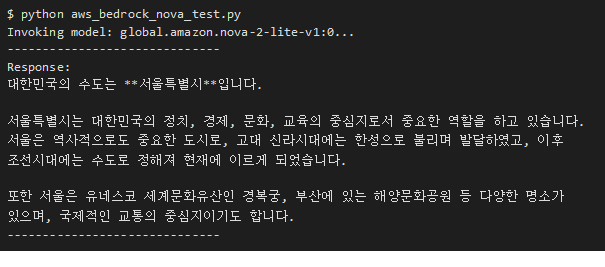

# 모델 호출 테스트 결과

3.2. GCP Vertex AI

- 모델 : Gemini 3.1 Pro Preview

[사전 설정 (Prerequisites)]

1. Vertex AI API 활성화: GCP 콘솔에서 Vertex AI API 사용 설정.

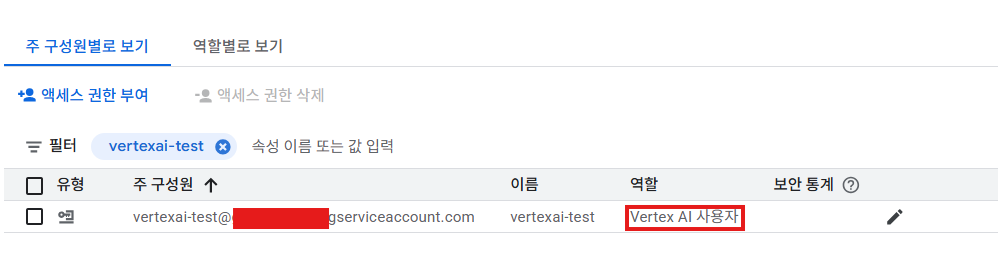

2. 서비스 계정 권한 설정 : VertexAI 호출에 사용될 서비스 계정에 ‘Vertex AI 사용자’ 역할 부여

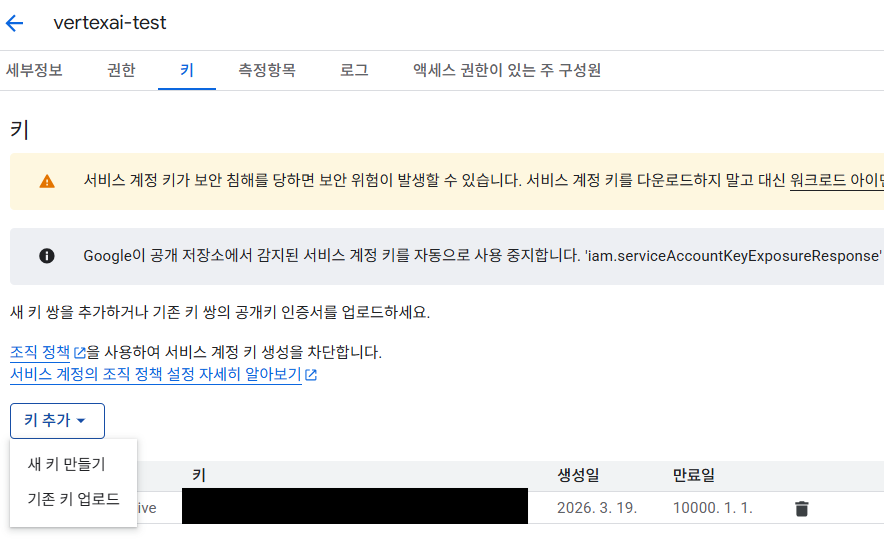

3. SA 키 파일 생성 및 복사 : 호출 환경 내 해당 서비스 계정 활성화를 위해 key 파일 생성 및 복사

4. 키 파일 경로를 절대 경로로 환경 변수 등록: ADC 인증에 사용할 키파일을 환경 변수로 지정

| export GOOGLE_APPLICATION_CREDENTIALS=”/xxxxx/sa.json” |

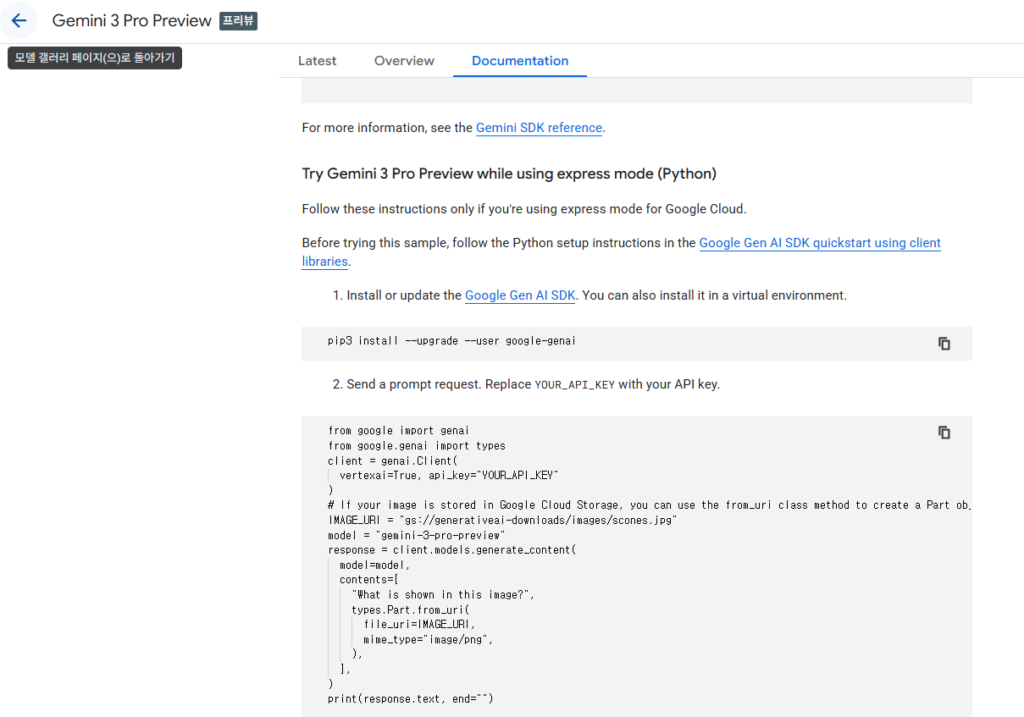

5. Model Garden에서 모델 문서 확인 : Model Garden에서 호출할 모델의 호출방법 및 Environment 확인

EX) gemini 3.0 pro preview

6. Google SDK 업데이트: 기존 VertexAI 라이브러리 업데이트 및 새로운 genai 라이브러리 설치

| $ pip install –upgrade google-cloud-aiplatform google-genai |

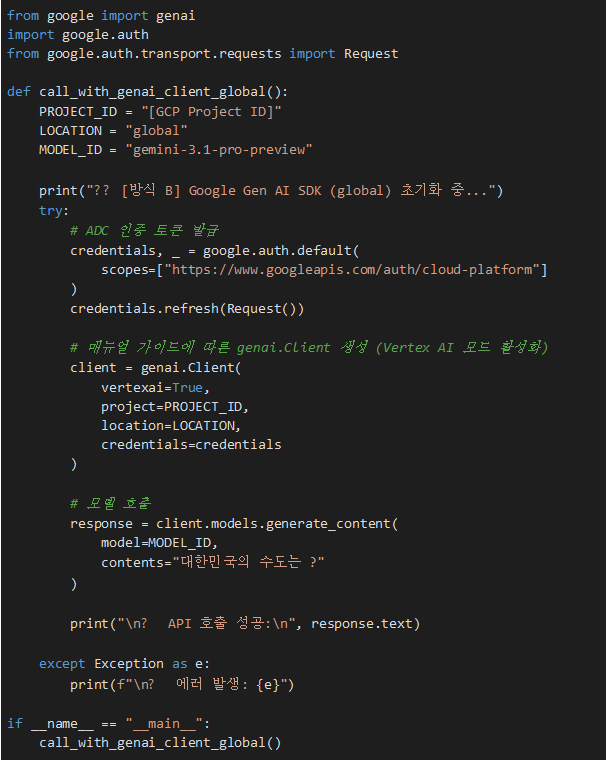

# GCP Vertex AI를 통한 Gemini 3.1 Pro Preview 모델 호출 스크립트

# 모델 호출 테스트 결과

| $ python vertexai_gemini3.1.py 🔄 [방식 B] Google Gen AI SDK (global) 초기화 중… ✅ API 호출 성공: 대한민국의 수도는 **서울**입니다. |

3.3. Microsoft Foundry (모델 : gpt-5.1 chat)

[사전 설정 (Prerequisites)]

1. 리소스 배포: Azure Portal에서 Azure OpenAI(MS Foundry) 리소스를 생성

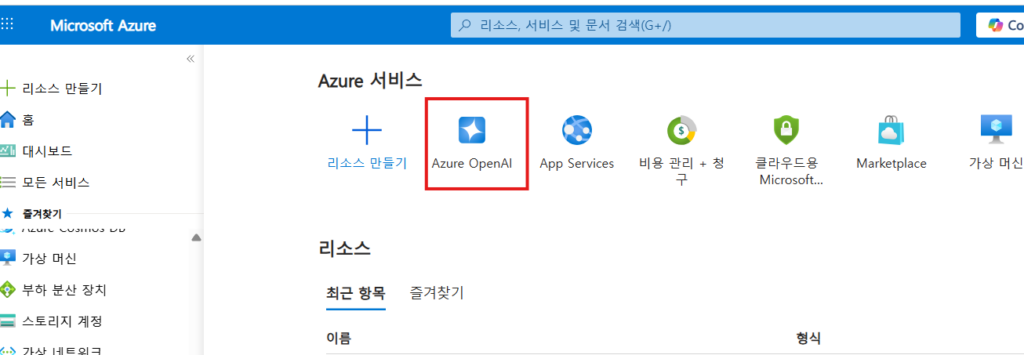

1.1 Azure Portal 화면에서 ‘Azure OpenAI’ 서비스 선택

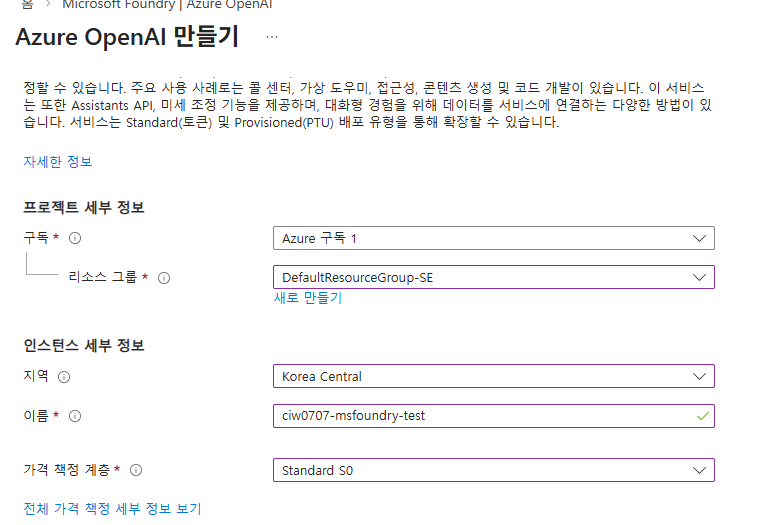

1.2 신규 Azure OpenAI 리소스 생성

1.3 Azure OpenAI 리소스 세부 설정

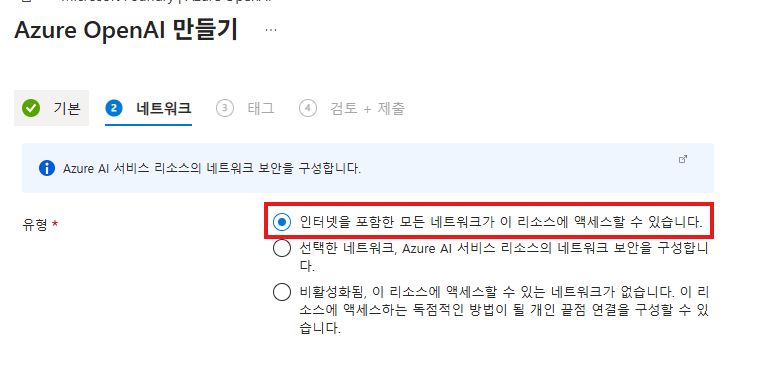

1.4 Azure OpenAI 리소스 네트워크 설정

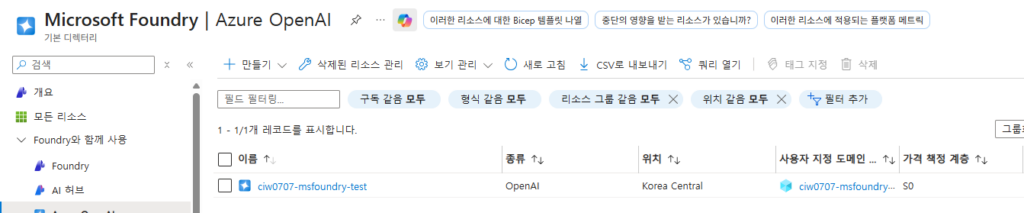

1.5리소스 정상 배포 확인

2. Foundry Portal 내 모델 배포 : Foundry Portal로 이동하여 사용할 모델을 선택 후 배포

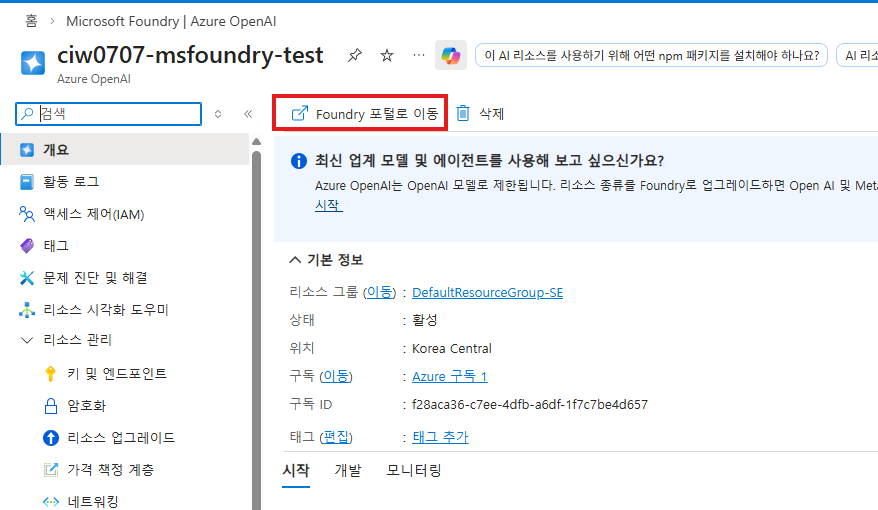

2.1 생성된 Openai 리소스 세부정보 페이지에서 ‘Foundry 포털로 이동’ 선택

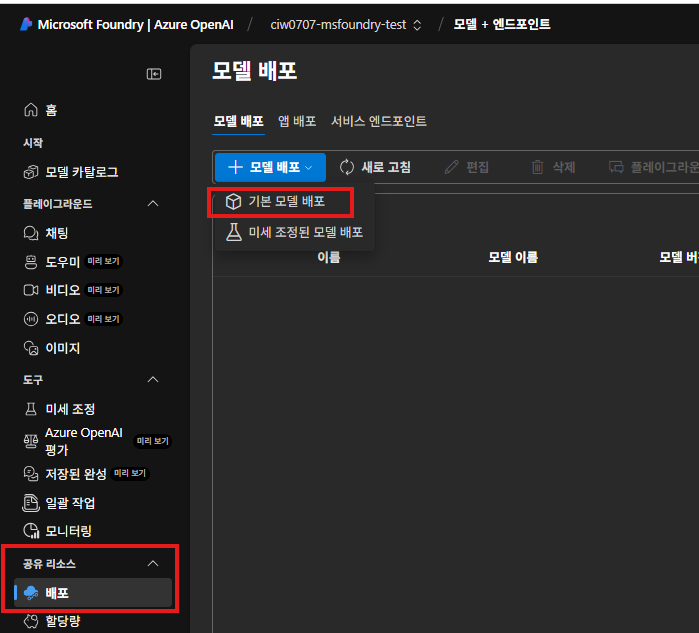

2.2 모델배포 메뉴에서 ‘기본 모델 배포’ 선택

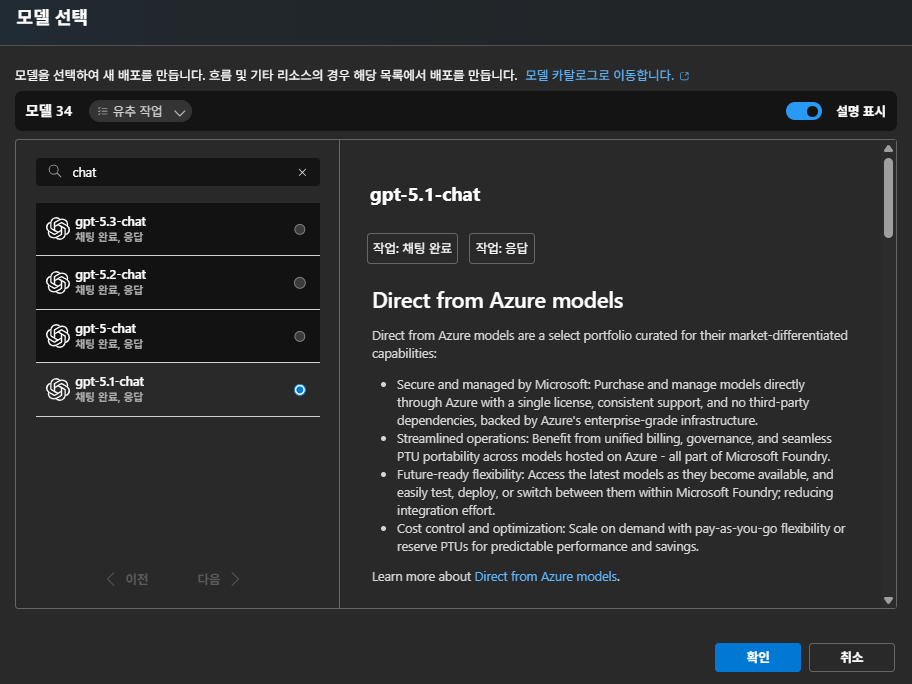

2.3 배포할 모델 선택

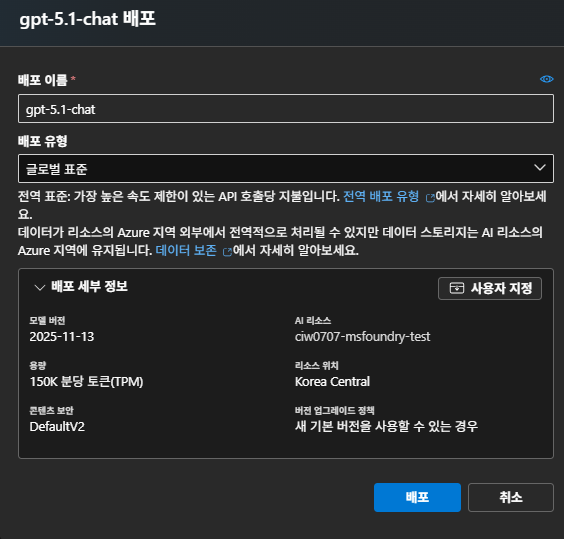

2.4 모델 배포 세부 설정 및 배포 진행

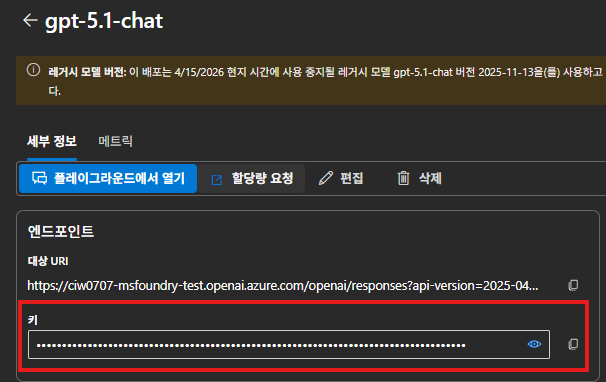

3. 배포 모델의 API 키 및 호출 방법 확인 : 배포 완료 후 모델 정보에서 API 키 및 호출 방법을 확인

3.1 모델 호출시 사용할 API 키 정보 복사

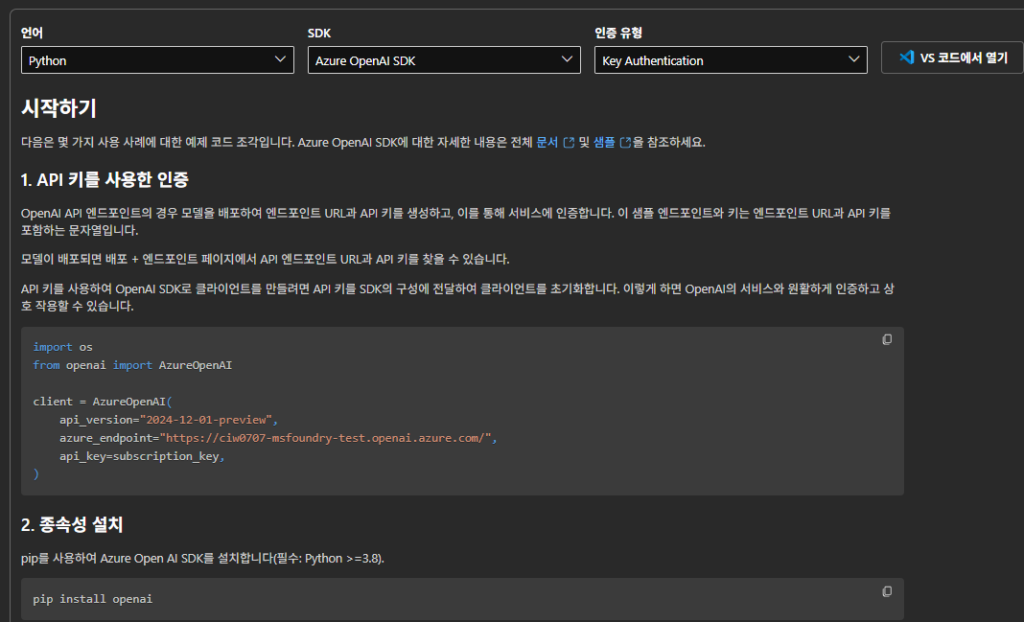

3.2 각 환경 별 모델 호출 방법 확인

4. OpenAI 라이브러리 설치 : 모델 호출을 위한 Openai 라이브러리 설치

| $ pip install openai |

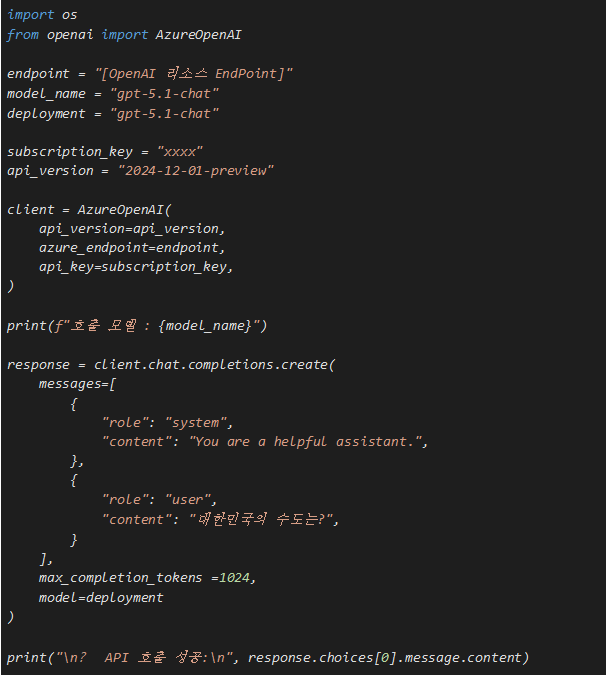

# Azure OpenAI (Microsoft Foundry)를 통한 GPT 5.1 Chat 모델 호출 스크립트

# 모델 호출 테스트 결과

| $ python ms_foundry_test.py 호출 모델 : gpt-5.1-chat ✅ API 호출 성공: 대한민국의 수도는 서울입니다. |

참고 문서

AWS Bedrock: https://docs.aws.amazon.com/ko_kr/bedrock/latest/userguide/what-is-bedrock.html

GCP Vertex AI: https://docs.cloud.google.com/vertex-ai/docs/start/introduction-unified-platform?hl=ko

Azure Microsoft Foundry: https://learn.microsoft.com/ko-kr/azure/foundry/what-is-foundry